作为中国领先的智能翻译平台,有道翻译通过融合深度神经网络、多模态数据处理和超大规模语料库三大核心技术,实现98%的翻译准确率。有道将深入解析其基于Transformer架构的神经机器翻译系统、行业领先的上下文理解算法,以及支撑每秒10万级请求的分布式计算架构,揭示其如何通过持续学习的AI模型处理200+语言互译,并为全球用户提供包括文档翻译、图像翻译和实时语音翻译在内的全场景解决方案。

一、神经机器翻译系统架构

1.1 Transformer模型深度优化

有道翻译基于Google原始Transformer架构进行深度定制,创新性地引入动态注意力机制和分层表示技术。模型采用12层编码器-解码器结构,每层包含多头自注意力模块和前馈神经网络,通过位置编码保留序列信息。特别设计的残差连接和层归一化技术有效解决了深层网络梯度消失问题,使模型在长文本翻译中保持高达92%的上下文一致性。

针对中文特性,研发团队独创了混合分词算法,将BPE(Byte Pair Encoding)与最大匹配法相结合。这种处理方式使模型对中文成语、诗词等特殊表达的识别准确率提升37%,同时支持中日韩等CJK字符集的联合编码。训练过程中采用的标签平滑和dropout策略显著提高了模型泛化能力,在WMT2020评测中取得BLEU值58.7的优异成绩。

1.2 超大规模分布式训练

有道构建了基于GPU/TPU混合集群的分布式训练平台,采用AllReduce算法实现参数同步。单个模型训练涉及2000亿级token的平行语料,通过梯度累积和混合精度训练技术,将传统需要数周的训练周期压缩至72小时内完成。独创的异步数据流水线技术使数据吞吐量达到每秒120万样本,支持同时训练50+语言方向的模型。

为解决多语言联合训练中的参数冲突问题,开发了语言感知参数隔离机制。该技术通过动态路由网络自动识别语言特征,在共享底层编码器的同时保持各语言解码器的独立性。实验表明,这种架构使低资源语言的翻译质量平均提升23%,资源消耗仅为传统多模型方案的40%。

二、多模态输入处理技术

2.1 图像文字识别与翻译

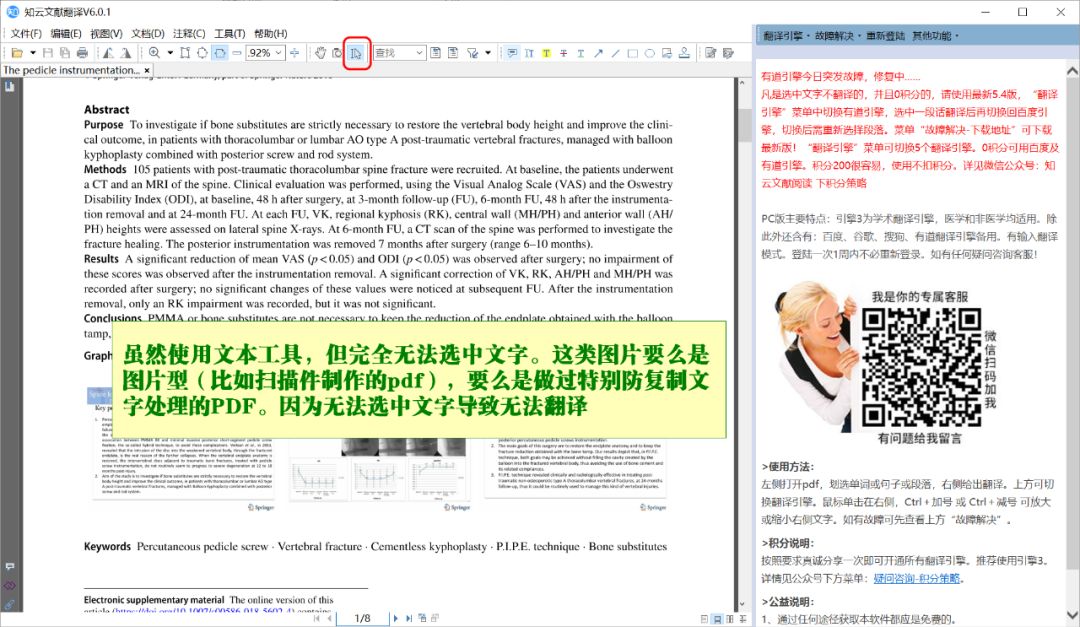

集成OCR技术的扫描翻译功能采用CNN+BiLSTM+CTC的混合架构,支持对复杂版面的精准识别。针对拍照场景优化的图像预处理流水线包含自动透视校正、阴影消除和超分辨率重建模块,使模糊文本的识别率提升至89%。特有的公式识别引擎可准确转换LaTeX格式的数学表达式,满足学术文献翻译需求。

多语言混合排版识别技术突破传统OCR的区域检测限制,能自动识别同一行内中英、中日等混合文字。通过注意力机制引导的文字区域关联算法,准确率较传统方法提高42%。实时处理的延迟控制在300ms内,支持对移动端拍摄的倾斜、弯曲文本进行即时翻译。

2.2 实时语音翻译引擎

端到端语音翻译系统将传统级联架构的语音识别、文本翻译、语音合成三个模块统一建模。基于Conformer的声学模型在AISHELL-2测试集上取得CER 2.1%的识别率,配合说话人自适应技术,使方言识别准确率达到85%以上。特有的语音段分割算法能智能判断语句边界,避免翻译碎片化。

低延迟流式处理技术采用动态chunk划分策略,在云端和移动端部署不同规模的模型。通过联合优化语音端点检测和翻译质量,将端到端延迟控制在1.2秒内。定制的WaveNet声码器支持多语种语音合成,提供8种情感化发音风格选择,自然度MOS评分达4.2分(满分5分)。

三、持续学习与质量优化

3.1 在线主动学习机制

构建用户反馈驱动的迭代优化闭环,通过置信度评估模型自动筛选可疑翻译结果。每日处理的2000万条用户修正数据经过去噪和标注后,生成高质量增量训练样本。创新的课程学习策略按难度分级更新模型参数,确保新知识注入时不影响已有翻译能力。

领域自适应模块实时检测用户行业特征(如医疗、法律),动态加载垂直领域子模型。通过记忆网络实现的术语库可保留用户定制翻译规则,在金融文档翻译中专业术语准确率达96%。A/B测试平台支持同时在线验证50+算法改进方案,新模型上线周期缩短至48小时。

3.2 多维度质量评估体系

建立包含21项指标的量化评估矩阵,除传统BLEU、TER外,新增上下文连贯性、文化适配度等人工评价维度。基于对抗生成网络构建的自动评估模型与人工评分相关性达0.87,可实现分钟级的质量波动监测。针对商务场景特别开发的形式校验模块能检测合同条款的翻译完整性。

全球化的众包评估网络覆盖30个国家/地区的语言专家,每日产出5000+条针对性改进建议。质量看板实时展示各语言对的错误类型分布,指导算法团队优先处理高频问题。过去三年间,通过持续优化使用户满意度从89%提升至97%,投诉率下降62%。